作者简介:董强(1989-),男,博士研究生.研究方向:遥感图像拼接技术.E-mail:dongqiang0518@126.com

经典的SURF算法存在许多不足,如特征描述符维度高、运算量大,对于旋转和拍射视角变换角度过大时,匹配精度低等。针对以上问题,提出了一种改进算法,首先通过Hessian矩阵提取特征点,然后采用特征点圆形邻域进行特征描述,使用Haar小波响应为每个特征点建立描述符,同时计算邻域内归一化的灰度差分及二阶梯度,形成新的特征描述符,最后采用RANSAC算法剔除误匹配点。该算法不仅较经典SURF算法具有速度优势,同时充分利用了灰度信息和细节信息,具有更高的精度。实验结果表明:该算法对图像的模糊、光照差异、角度旋转、视场变换等均有良好的鲁棒性和稳定性。将该算法应用于遥感图像拼接,得到无明显几何移位、边缘衔接良好的拼接图像。该算法是一种耗时短、精度高的图像配准算法,能够满足遥感图像拼接对配准的要求。

To overcome the redundant feature descpriptor, high computational complexity, low matching precision when the angle of rotation or view spends greatly in image registration method based on SURF algorithm, an improved SURF algorithm is proposed. First, the feature points are extracted using Hessian matrix. Then, the feature descriptor for each keypoint in the circular neighborhood is constructed using Haar wavelet response; meanwhile, the normalized gray values difference and second-order gradient of this region are computed. Finally, RANSAC algorithm is applied to eliminate false matches. This method not only performs faster than SURF algorithm, but also fully employs the image gray information and details to acquire higher accuracy. Results indicate that the proposed method has strong robustness and stability for blur, illumination difference, angle rotation and viewpoint change. A well-edge mosaic image is obtained without obvious geometric misalignment in the remote sensing image mosaicking process. This method is an effective image registration algorithm with high-speed and precision, and it satisfies the need of registration in the remote sensing image mosaic.

近年来, 随着计算机技术的飞速发展, 图像处理技术也得到空前的提升, 作为其重要组成部分的图像配准已经广泛应用于图像拼接、目标识别、医学图像处理等各领域[1]。图像配准技术的方法大体分为两类:基于灰度信息的配准方法和基于特征的配准方法[2]。基于灰度的图像配准方法较为简单, 直接计算两图像灰度值的关系来匹配图像, 这种方法虽然简单、易实现, 但其稳定性差, 对光照变化敏感。相比之下, 基于特征的配准方法具有良好的稳定性, 在克服图像的光照、尺度、旋转等变化具有更好的鲁棒性, 是目前主流的图像配准方法[3]。

为了提高配准精度和速度, 学者们对图像的特征进行了许多研究, 如图像的点特征[4, 5, 6]、轮廓特征[7, 8]、边缘特征[9, 10]等。SIFT(Scale invariant feature transform)特征检测算法[11, 12, 13, 14]是基于尺度空间的, 对于图像的各种变化都具有良好的适应性, 但是, SIFT也存在着算法复杂、耗时长、计算效率较低等问题。PCA-SIFT[15]是SIFT的改进算法, 该算法大大提高了SIFT的匹配速度, 但是其鲁棒性不如SIFT。Bay等[16]于2006年提出了一种SIFT的改进算法— — SURF(Speeded up robust feature)算法。该算法速度更快且性能稳定, 但仍存在特征描述符复杂, 运算量大, 对于旋转和视场角度变换过大时, 匹配精度低等问题。

针对上述问题, 本文提出一种改进的特征描述符, 将SURF算法的方形邻域变为同心圆环, 同时, 加入图像的灰度特征及二阶梯度特征, 使其具有更好的稳定性, 特征描述符由64维降到26维, 减少特征匹配耗时, 提高运行速度。最后, 使用RANSAC (Random sample consensus)[17, 18]进行误匹配点剔除, 提高精度。

经典的SURF算法主要分为以下4个步骤完成。

(1)特征点提取。选取不同尺寸的盒子滤波器生成图像的尺度空间, 利用快速Hessian矩阵行列式确定特征点的位置, 同时在尺度空间和图像空间插值, 精确定位特征点的尺度和位置。

(2)主方向分配。以特征点为圆心, 6S(S为尺度)为半径的圆, 计算y方向和x方向的Haar小波响应, 并根据距离特征点远近进行高斯加权, 统计60° 扇形内的响应, 计算响应之和, 以小角度(一般为5° )旋转扇形遍历整个圆, 选取最大值方向为该点的主方向。

(3)描述符生成。以特征点为中心旋转坐标轴到主方向后, 选取边长为20S的正方形区域, 并将其划分为16个子区域(每个子区域大小为5S× 5S), 计算每一点的Haar小波响应, 并赋给权值, 统计每个子区域的水平、垂直方向的响应及其绝对值, 这样就可得到一个64维的特征描述符。

(4)特征点匹配。采用最小欧氏距离准则来进行特征点匹配。

虽然SURF算法在工程上具有广泛的应用, 但其特征描述符冗余、计算量大, 不能满足工程中实时性的要求, 当两幅图像光照变化强烈时, 其匹配效果不理想, 同时, 对于图像配准中经常出现的大角度旋转和三维视角变换等问题, SURF算法也不能满足要求。

针对经典SURF算法中存在的问题, 本文从以下3个方面进行改进。

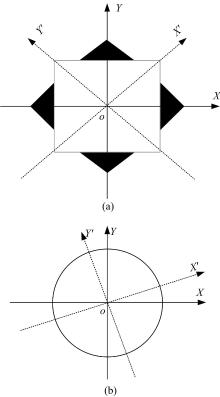

(1)采用圆形邻域进行特征描述符的提取。经典SURF算法的主方向确定对于特征点描述符的生成起着至关重要的作用。SURF算法的描述符准确与否依赖于主方向的确定。经典SURF算法采用矩形区域进行特征描述符的计算, 当主方向确定出现误差时, 其描述符计算区域会发生变化, 如图1(a)所示。本文采用圆型区域计算特征描述符, 当主方向存在误差时, 其计算区域相同, 如图1(b)所示。

(2)引入区域灰度值差分作为特征描述符的一部分, 可在一定程度上克服光照对于配准的影响。

(3)引入二阶梯度值作为特征描述符的扩展。二阶梯度值是图像纹理细节信息的一种直观反映[19], 为了更好地利用图像的细节, 本文将二阶梯度引入特征描述符, 以增加算法的鲁棒性和健壮性。本文使用的二阶梯度计算方法如下:

记图像I(x, y)的灰度值为f(x, y), 在数字图像中以差分来近似替代导数, 以gy(x, y)表示该点在y方向上的一阶梯度, 其计算式为:

图像在该点的y方向二阶梯度值记为hy(x, y), 其计算式为:

将式(1)代入式(2), 整理可得:

式中:t[i]为系数矩阵, t[i]=[0, 1, 2, 1, 0, -2, -4, -2, 0, 1, 2, 1, 0]。

同理, 可以求出x方向的二阶梯度为:

图像点I(x, y)的二阶梯度和方向计算式为:

本文算法与SURF前两步其本一致。首先, 用不同尺寸的滤波器模板构建尺度空间提取特征点, 本文算法在提取特征点时进行边缘抑制, 去除过边缘点, 为后面的步骤节省时间。然后, 确定主方向, 以特征点为中心, 将坐标轴旋转到主方向。

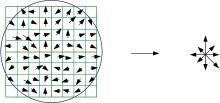

(1)以特征点为中心, 选取半径分别为r1=3

(2)在每一个子区域计算每一个点在水平方向和垂直方向上的Haar小波响应值, 同时将以特征点为中心的高斯加权系数赋予这些响应值, 以达到增强算法稳健性的目的, 然后计算每个子区域响应值的和。这样, 每一个子区域就得到Vsub:

由式(7)可知, 该步特征描述符是3× 4=12维的。表示为:D=(d1, d2, …, d12), 将D进行归一化:

(3)计算区域的灰度值之和, 记:半径为r1、r2、r3的圆内区域像素的灰度值之和分别为f1、f2、f3, 得到一个三维描述符:F=(f1, f2, f3)。将F=(f1, f2, f3)进行归一化处理:

(4)根据步骤(3)得到的(

(5)根据式(5)(6)计算半径为r3的圆内所有点的二阶梯度值及方向, 并赋予以特征点为中心的高斯加权系数, 然后, 计算8个方向的二阶梯度和, 生成一个8维向量(h1, h2, h3, h4, h5, h6, h7, h8), 并进行归一化, 生成8维向量(

(6)生成26维描述符:

采用最小欧氏距离准则进行特征点匹配。计算特征向量的最小欧氏距离和次小欧氏距离的比值, 记:待配准图像中与参考图像特征点欧氏距离最近的两个关键点的欧氏距离为d1、d2。

设定阈值T(一般为0.6~0.8, 本文取0.6), 若比值小于阈值则认为两点为正确匹配点对, 遍历所有特征点, 得到全部匹配点对。

由上述度量方法进行匹配的特征点会存在一定的误匹配点, 故本文采用RANSAC算法剔除误匹配点, 提高匹配正确率。RANSAC是随机采样一致性算法, 此算法的原理为:随机选取m个点计算模型参数, 然后利用得到的模型衡量其他点, 把小于阈值的点作为内点。重复以上过程n次, 选择内点最多的点集计算准确的模型参数。该算法不仅可以有效剔除大量误匹配点, 还可以得到鲁棒性更好的估计结果。

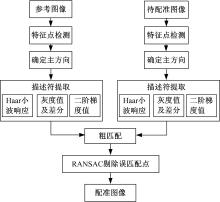

综上所述, 图像配准算法流程如图4所示。

针对本文提出的改进SURF算法, 采用了大量图像进行了图像配准实验, 并将本文算法与SIFT算法和SURF算法进行比较, 对其匹配性能进行了定量评价与分析。同时, 将本文算法用于遥感图像拼接, 并对拼接精度进行评价。

算法运行环境如下:CPU为Intel core i5, 3.20 GHz, 内存为4 GB的PC机, 32位Win7操作系统, 仿真软件为Matlab 8.1.0.604(R2013a)。

本文采用3个参数对图像匹配的效果进行综合评价。

(1)采用运行时间(加上RANSAC算法时间)对匹配速度进行评价。

(2)采用匹配性能客观评价指标— — 匹配正确率CMR(Correct matching rate), CMR值越大, 匹配性能越好, CMR定义如下:

式中:N为所有匹配点对数; Nc为正确匹配点对数。

(3)采用均方根误差RMSE(Root mean square error)进行参考图像与配准后图像之间的距离度量, 两者距离越大, 则RMSE的值越大, 说明配准精度越低, 配准效果越差, 反之, 配准效果越好[20]。RMSE的计算公式如下:

式中:M为最终匹配点对的数目; (x'i, y'i)为待配准图像中特征点的坐标; (xi, yi)为参考图像中特征点的坐标; f(· )为仿射变换模型。

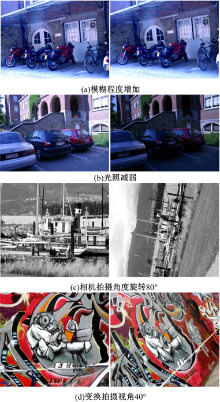

采用4对测试图像分别对算法的抗模糊、光照、旋转、视角变换性能进行测试, 如图5(a)~(d)所示, 图像尺寸分别为1000× 700、800× 640、850× 680、800× 640像素, 使用SIFT算法、SURF算法和本文算法进行配准。

表1为匹配运算时间, 表2为匹配点对和正确率, 表3为配准精度评价指标(均方根误差)。

| 表1 运算时间 Table 1 Run time s |

| 表2 匹配点对和正确率 Table 2 Matching pairs and correct matching rate |

| 表3 均方根误差 Table 3 Root mean square error |

由表1可以看出, 本文算法用时比SIFT算法和SURF算法更少, 相较于SIFT算法和SURF算法, 速度分别提高97.61%和22.94%。尤其当图像复杂度较高时, 本文算法速度优势明显, 这是因为本文采用26维描述符, 大大减少了特征描述符提取和匹配用时, 故此算法具有速度优势。

由表2可以看出, SIFT算法在抗模糊、光照、旋转方面性能优越, 提取出的提征点多且匹配正确率高, 但其对视角变换提取的特征点较少, 往往不能满足要求。本文算法匹配正确率均高于SURF算法, 且对于光照、旋转、视角变化均有显著提高, 相较于SURF算法, 匹配正确率平均提高10.84%。

由表3可以看出, SIFT算法RMSE值最小, 匹配精度最高。本文算法RMSE的值均小于SURF算法, 平均减小22.61%, 算法精度提高。

在获得两幅图像的精确匹配特征点对后, 由式(15)图像变换关系可以求解出变换矩阵H, 将待配准图像I'通过H进行变换后与参考图像I进行叠加, 就可得到拼接图像。

式中:(x', y')和(x, y)分别为待配准图像I'和参考图像I的匹配点对。

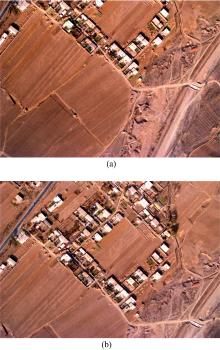

采用图6所示的两幅图像进行拼接精度测试, 人为在图像的重叠区域加入十字监测点, 图6(a)中绿色的点和图6(b)中红色的点是人为加入的3组十字监测点, 每组含17个独立点。

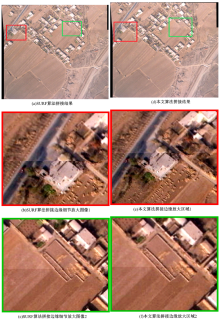

对图像进行拼接, 并高亮显示重叠区域, 得到图7所示图像。将其中一组监测点放大并标记每个点的序号, 如图8所示。记录每个监测点的坐标, 并求出每个监测点间的距离, 对其他两组十字监测点进行相同操作。

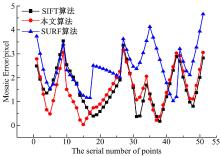

对图6中的两幅图像分别采用SIFT算法、SURF算法和本文算法进行拼接实验, 记录各监测点间的距离的均方根误差(RMSE)。将3种算法的实验数据进行对比, 如图9所示。由图9可以看出, 本文算法的平均RMSE=1.2653, SURF算法的平均RMSE=1.8727, SIFT算法的平均RMSE=1.2275。由以上数据对比可知, 使用本文算法获得的拼接图像精度虽较SIFT算法略低, 但较SURF算法有显著提高, 平均提高32.43%。

针对经典SURF算法存在的运行时间长、对于大角度旋转及视角变化配准效果差的问题, 本文提出一种全新的特征描述符, 将经典SURF算法特征描述符提取采用的方形区域改变为同心圆环区域, 大大加强了算法的稳健性。同时, 利用归一化的灰度差分描述该区域的灰度特征, 从而令其对光照变化有更好的稳健性。引入区域内的二阶梯度因子, 更充分地利用图像的细节信息, 增强了算法的鲁棒性和适应性。最后, 采用RANSAC算法剔除误匹配点, 进一步提高算法的配准精度。将特征描述符从64维降至26维, 大大减少了特征提取及匹配用时, 使该算法具有速度优势。实验证明本文算法对图像的模糊、光照、旋转缩放及视角变化都优于经典SURF算法, 同时算法运行耗时更少。本文算法能够有效利用图像的细节信息, 提高匹配正确率, 为图像拼接提供更为准确的变换模型。在遥感图像拼接实验中, 本文算法精度高, 较SURF算法有明显提高, 拼接边缘无明显错位, 衔接良好。本文算法速度快、耗时短, 在遥感图像拼接等实时性要求高等领域具有现实意义, 为向高速实时图像处理硬件平台的移植提供可能。综上所述, 本文算法相较SURF算法更具优越性, 是一种有快速、稳定、有效的图像配准新方法。

The authors have declared that no competing interests exist.

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

|

| [15] |

|

| [16] |

|

| [17] |

|

| [18] |

|

| [19] |

|

| [20] |

|