杨扬(1986),男,博士研究生.研究方向:图像融合.E-mail:yyustc@126.com

针对同一场景的多聚焦图像,提出了基于非下采样Bandelet变换(NSBT)的图像融合方法。首先求出源图像的平均图像,再利用该图像的小波系数计算出最优的几何流,进而构造出一组Bandelet基,然后将源图像通过这组基进行表示,对得到的系数按所对应的不同物理意义分别进行融合,最后将融合系数进行非下采样Bandelet逆变换得到融合图像。实验结果表明,与基于小波变换(WT)和非下采样小波变换(NSWT)的融合方法相比,本文所提方法取得了更好的视觉效果和量化指标。

A novel fusion algorithm based on nonsubsampled Bandelet transform is proposed for the multifocus images of same scene. First, the average image is calculated from the source images, after that the best geometric flow is computed using the wavelet coefficients of the image and a Bandelet basis is constructed. Secondly, the source images are represented using the Bandelet basis, and then the obtained coefficients are fused respectively according to their physical significance. Finally, the fused coefficients are applied on the inverse nonsubsampled Bandelet transform to obtain the fused image. The experiment results indicate that, compared with the fusion methods based on Wavelet transform and nonsubsampled Wavelet transform, respectively, the proposed method can provide better fusion quality in terms of both visual sense and quantified measure.

基于多尺度分析的图像融合方法是图像融合领域最为常见的一类方法[ 1, 2],它的主要依据是:客观存在的物体是由不同尺度下的各种物理结构所组成,在不同尺度上观察物体,物体会显示出不同的物理特征。该方法将待融合图像进行多尺度分析,获得图像在各个尺度下的特征信息,把这些信息进行融合处理,合并重要的部分,经过多尺度重建得到特征充分的融合图像。常见的多尺度分析工具主要有Pyramid、Wavelet、Curvelet、Contourlet等。在处理复杂图像时,以上方法由于非自适应于具体图像,无法最稀疏地描述图像信息,容易造成融合过程中系数选取得不准确,导致融合图像出现边缘模糊和伪噪声。

2005年Peyré和Mallat[ 3]提出了一种新的多尺度分析方法——第二代Bandelet变换,该变换避免了原Bandelet变换中繁琐的重采样和弯曲操作以及容易出现的边缘效应,是一种自适应、非冗余的正交变换。Mallat在文献[4]中证明,对于

图像中的边缘,纹理等几何结构在一定方向上均存在正则性,比如图像在平行于物体边缘的方向上可微。对于正则化程度越大的信号,其在最优小波基下的逼近误差越小,即图像的大部分信息集中在更少的系数中。大多数多尺度变换对图像几何结构缺乏先验知识,使用预先固定的基(或框架)来分析图像,没有有效地利用图像各项异性的正则性,因此无法较稀疏地描述图像中的几何特征。

第二代Bandelet变换是一种新的多尺度变换,其核心思想是为图像中的几何特征定义矢量场(几何流),矢量所指示的方向即为该位置处几何特征的正则化方向,将小波域系数分割为各个子块,每一子块对应了一个固定的几何流,进一步对块中数据“Bandelet化”来获取最优的非线性逼近能力。Bandelet基函数与各子块中的几何流相对应,具有自适应性,因此能更有效地刻画图像中的方向性特征。图1显示了在图像小波域中某子块S的几何流,图中的箭头代表该点的几何流。

第二代Bandelet变换的主要步骤如下:

(1)对图像进行二维离散小波变换,得到尺度

(2)将

(3)在各子块S中按离散的网格格点与子块中心的位置关系确定各种可能的正则化方向,其总数应小于

(4)将块S中的数据进行正交方向(垂直于几何流)的投影,按投影数据的位置顺序对原数据从左至右排列后得到一维数据

(5)对

(6)设定阈值

然后选择最优的几何方向,使得式(2)所示的Lagrangian函数取得最小值:

式中:

(7)将最优几何方向

(8)根据Lagrangian函数最小化原则,借助分类和回归树模型,自底向上地合并各子块,从而建立最优的四叉树结构。叶子节点对应了最终Bandelet子块,子块中的系数

第二代Bandelet变换步骤(1)中使用的小波变换为非冗余的正交(双正交)小波变换,该变换不能有效地捕获图像的某些细节信息,而且由于缺乏平移不变性,容易在图像奇异处产生伪Gibbs效应。本文因此使用非下采样的小波变换(NSWT)[ 5]:

该变换是一种冗余的图像表达方式,提供的系数数据为原始图像数据的

非下采样的Bandelet变换(NSBT)是第二代Bandelet变换的改进形式,它取消了原变换中二维小波变换所涉及的下采样过程,因此具有一定的数据冗余,进而可以为融合过程提供更丰富的源信息,并且该变换具有平移不变性,可以有效减少因源图像误配准对融合过程造成的影响。

基于非自适应变换的融合方法是将源图像通过一组固定的基进行表示,对得到的变换系数按照一定的规则进行融合处理,最后再通过这组基对融合系数重建得到融合图像,该过程中源图像对应的变换系数是通过同一组基投影得到的,因此对系数的各种融合操作具有合理性。而Bandelet变换是一种自适应的变换,由于源图像之间的几何结构存在差异,对应Bandelet子块中小波系数的正则化方向也不可能相同,由此得到的图像基函数是不一致的,导致建立在不同基函数上的Bandelet系数之间不具有可比较性,对其进行各种融合运算缺乏合理的依据,因此常见的融合框架不再适用于这类变换的融合,有必要使用一种新的方案。

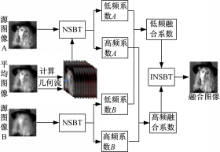

考虑到多聚焦图像,源图像之间具有一定的相似性,文本使用如图2所示的融合方案(以两幅源图像的融合为例),该方案主要包括以下步骤:

(1)计算待融合源图像的平均图像。

(2)利用所得图像计算各尺度下Bandelet子块中的几何流。

(3)该几何流对应了一组Bandelet基,利用这组基对源图像做非下采样Bandelet变换。

(4)将变换得到的低、高频系数分别按一定的融合规则进行选取。

(5)对得到的低频融合系数和高频融合系数进行非下采样Bandelet逆变换(INSBT);最终获得融合图像。

由于该方案中得到的Bandelet系数是建立在相同的Bandelet基上的,因此对其进行相关的融合运算是合理的。

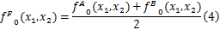

图像经NSBT分解后的低频系数代表了图像的近似分量,包含了大部分的能量信息;高频系数则代表了图像不同尺度下的细节信息,包括几何结构的正则化方向和正则化程度。考虑到各频带系数对应的物理意义不同,本文使用如下融合规则:

(1)低频融合系数。NSBT得到的低频系数可以看作是具有各项同性正则化的图像,因此没有进行任何“Bandelet化”操作,该系数也就是NSWT得到低频系数。本文使用各源图像低频系数的平均值作为最终的低频融合系数。设

式中:

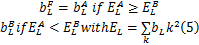

高频部分使用如下的融合方案:

即选择绝对值较大的高频系数作为融合系数。

实验将所提方法与常见的基于非自适应变换的融合方法进行了比较,它们分别使用小波变换(WT)、非下采样小波变换(NSWT)作为多尺度分解和重构工具。使用与本文类似的融合规则,即取源图像低频系数的平均值为低频融合系数,绝对值最大的源高频系数为高频融合系数。实验源图像如图3所示,图3(a)(b)为真实的已严格配准的多聚焦图像,图3(c)(d)为人工仿真的多聚焦图像,尺寸均为256×256像素。为便于直观感受融合效果,所选图像均有完全聚焦的标准图像作为参考。为了公平比较上述方法的融合效果,各算法中尺度分解均为3层。其中WT和NSWT使用“9-7”滤波器进行分解,NSBT使用“9-7”滤波器进行二维变换,使用“haar”滤波器进行一维变换。

实验使用融合图像和残差图像作为实验效果的主观判据,残差图像通过参考图像与融合图像相减得到,图中残留的图像信息越少,说明融合图像与参考图像越接近,融合效果越好。为了便于观察,将残差图像的灰度值放大5倍显示。实验采用峰值信噪比(PSNR)、互信息(MI)[ 7]、边缘保持度( QAB/F)[ 8]作为融合性能的客观量化指标,它们分别定义如下:

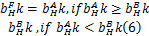

(1)峰值信噪比(PSNR)的具体定义为

式中:R、F分别为参考图像和融合图像;

峰值信噪比越高说明融合图像与参考图像越接近。

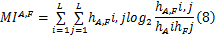

(2)互信息(MI)从统计学角度定义了两幅图像的相关性。源图像A和融合图像F的互信息为

式中:

源图像B和融合图像F的互信息用MIB,F表示。融合结果通过各源图像和融合图像互信息的和来评价,即MI=MIA,F+MIB,F。互信息值越大,表示融合图像从源图像提取的信息越多,融合的效果也越好。

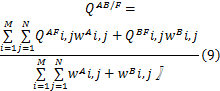

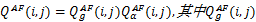

(3)边缘保持度( QAB/F)的定义为

式中:

图4分别显示了4组源图像的融合结果。从实验中可以看出,基于WT融合方法得到的残差图像各种特征较为明显;基于NSWT的融合方法得到的残差图像中出现的物体特征较少;基于NSBT融合方法的残差图像残留的信息最少,且轮廓细节比较均匀。造成以上现象的原因是WT方法得到的系数量不够冗余,融合结果对系数的融合规则比较敏感,容易受噪声和误配准影响。基于NSWT的融合效果有较大改善,但其对图像中的几何特征表示仍不够理想,在物体的边缘处仍有较多残差。NSBT融合方法以近似最优的形式表示图像,更集中地反映了图像的几何特征信息,降低了噪声等外来因素的影响,使随后的融合系数选取更加准确,因此图中残差较少且模糊。需要注意的是,WT融合方法的残差图像中物体的边缘均出现了明显的振荡条纹,这主要是因为各尺度下对应位置的融合系数的来源可能不一致,会在融合图像中产生伪Gibbs现象,而WT存在下采样操作,所造成的频率混叠会加剧这种效应。由于余下两种方法具有平移不变性质,这种现象明显地减小了。表1列出了各融合方法的量化评价数据。可以看出,基于WT的融合方法的量化结果最差,基于NSWT的融合方法的结果有较大改善,基于NSBT的融合方法的结果均优于其他融合方法,这也与从图4中获得的直观感受一致。

| 表1 不同融合方法的客观评价 Table 1 Objective assessment of different fusion methods |

提出了Bandelet变换的非下采样形式,并应用于多聚焦图像融合中,针对该变换的自适应性,提出了一种合理的融合框架,考虑到系数所对应的不同物理意义,制定了合适的融合规则。在实验中,从主观和客观两方面比较了所提方法和常见基于非自适应变换的融合方法。实验表明,本文所提融合方法保留了大部分源图像中的特征信息,有效地减少了伪Gibbs现象,取得了比较好的融合效果。

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|